Transformer在医学影像中的应用综述-分割

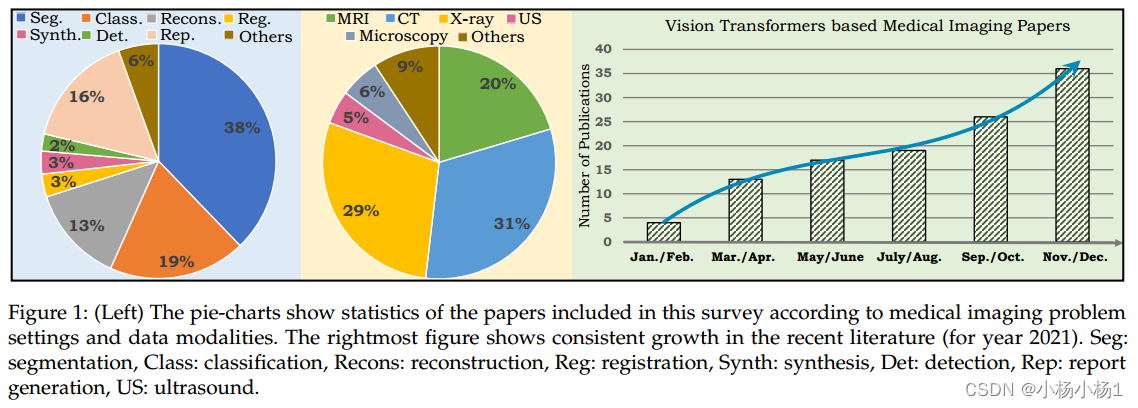

摘要:继在自然语言任务上取得前所未有的成功之后,Transformers 已经成功地应用于几个计算机视觉问题,取得了最先进的结果,并促使研究人员重新考虑卷积神经网络(cnn)作为事实上的算子的霸主地位。利用计算机视觉的这些进步,医学成像领域也见证了与具有局部接受域的cnn相比,能够捕获全局上下文的Transformers的兴趣越来越大。受这种转变的启发,在本调查中,我们试图全面回顾Transformers 在医学成像中的应用,涵盖各个方面,从最近提出的建筑设计到未解决的问题。具体来说,我们研究了transformer在医学图像分割、检测、分类、重建、合成、配准、临床报告生成等任务中的应用。特别是,对于这些应用程序中的每一个,我们都开发了分类,确定了特定于应用程序的挑战,并提供了解决这些挑战的见解,并强调了最近的趋势。此外,我们对该领域的整体现状进行了批判性的讨论,包括确定关键挑战,开放问题,并概述了有希望的未来方向。我们希望这项调查将进一步点燃社区的兴趣,并为研究人员提供有关Transformer模型在医学成像中的应用的最新参考。

方法

1.手工的方法

解决医学成像任务的传统算法是基于由现场专家利用领域知识设计的手工制作的数学模型。针对一系列医学成像问题,开发这些专注于精炼判别特征和高效优化算法的手工模型一直是过去的中心研究课题。医学成像中成功的手工制作模型包括全变分、非局部自相似性、稀疏性/结构化稀疏性、小波系数上的马尔可夫树模型和未经训练的神经网络。这些模型在医学领域被广泛用于图像分割、重建、疾病分类、增强和异常检测,因为它们具有坚实的数学基础和鲁棒性、恢复性和复杂性方面的理论支持。此外,与基于深度学习的方法不同,它们不需要大型带注释的医学成像数据集进行训练。

然而,由于无法充分利用大型医学影像数据集的表达能力,这些手工制作的模型往往具有较差的判别能力。因此,这些模型往往不能代表高维复杂医学成像数据的细微差别,从而影响医学成像诊断系统的性能。为了避免差的判别性和泛化问题,人们提出了学习手工模型来更好地利用数据。代表性的方法包括最优方向、K-SVD、数据驱动的紧框架、低秩模型和分段平滑图像模型。接下来,我们将解释文献中探讨的流行的数据驱动方法。

2.基于卷积的方法

cnn能够有效地从大规模医疗数据集中学习判别特征和提取可泛化先验,从而在医学成像任务中提供出色的性能,使其成为现代基于人工智能的医学成像系统的重要组成部分。cnn的进步主要得益于新颖的架构设计、更好的优化程序、特殊硬件(如gpu)的可用性和专门构建的开源软件库。

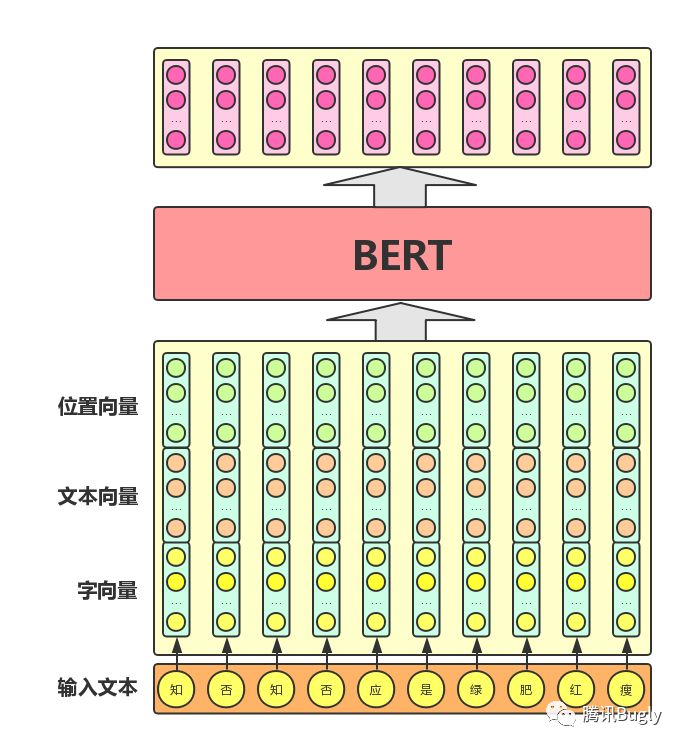

3.基于Transformer的方法

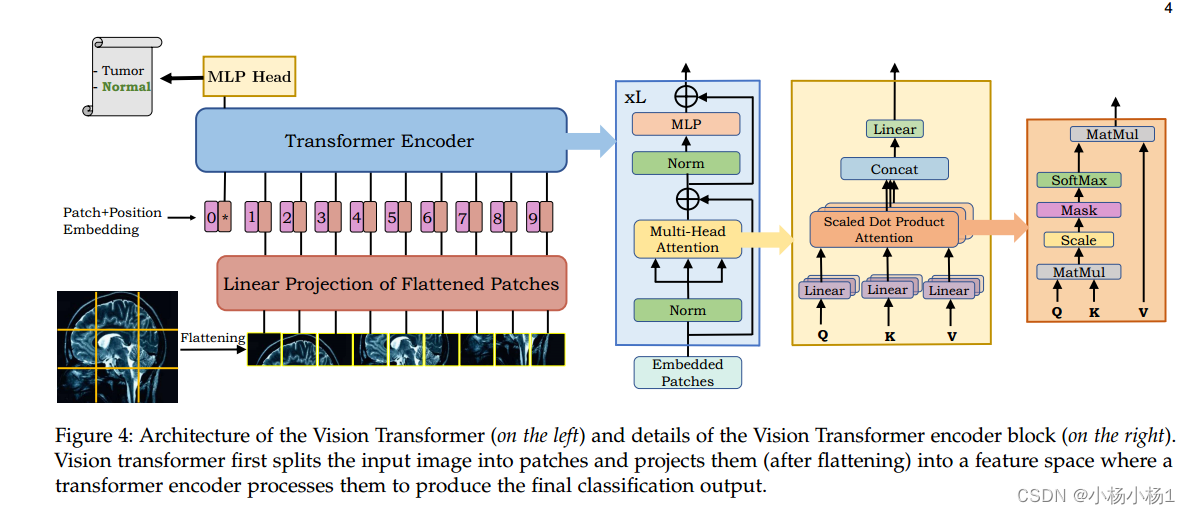

4.Vit的结构

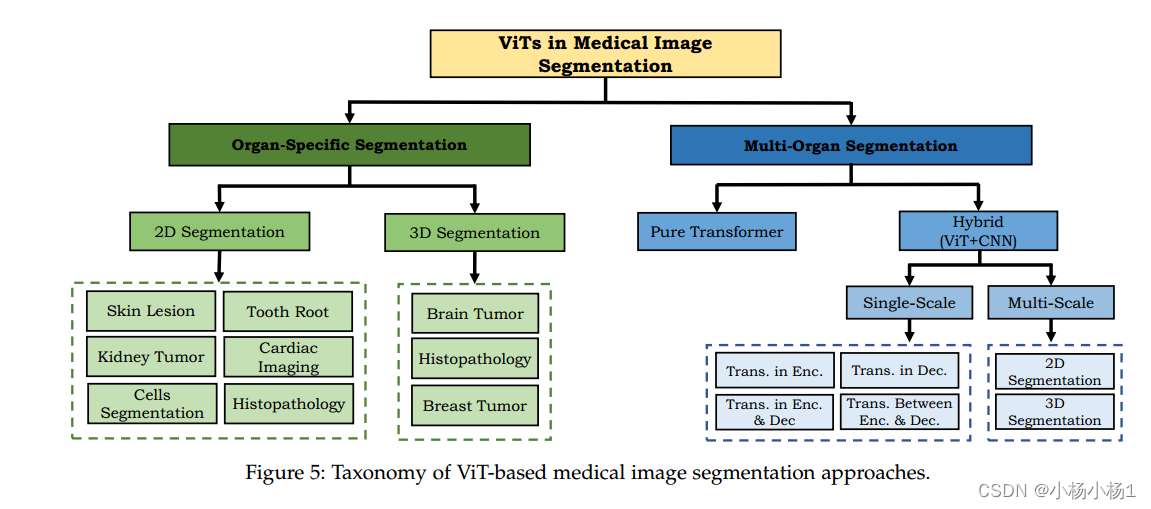

5.影像分割

2D

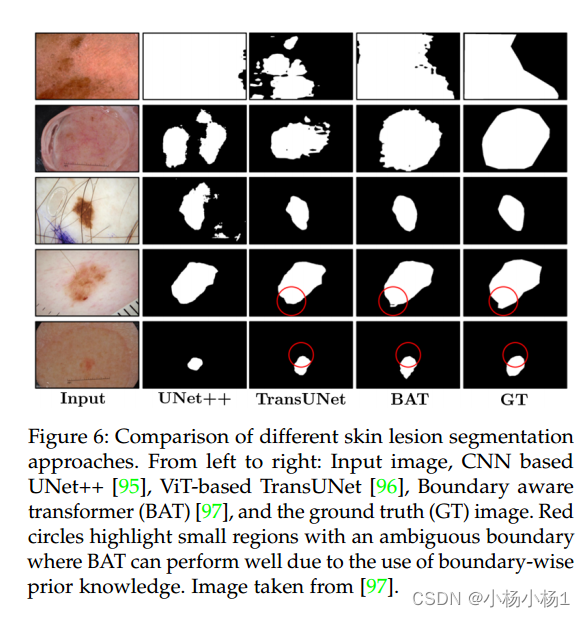

BAT:边界感知Transformer,在Transformer架构中设计了一个边界智能注意门,以利用关于边界的先验知识。对边界注意门的辅助监督为有效训练BAT提供了反馈。

FAT-Net:基于双编码器的特征自适应Transformer网络:由编码器中的CNN和Transformer支路组成。为了有效地融合这两个分支的特征,设计了高效存储的译码器和特征自适应模块。

GT U-Net:由变压器层和卷积层组成的分组Transformer U-Net,分别对全局和局部上下文进行编码。已经提出了一种形状敏感的傅立叶描述子损失函数来处理模糊齿边界。此外,在GT U-Net中引入了分组和瓶颈结构,大大降低了计算成本。

AGMB-Transformer:解剖引导多支路Transformer:结合群卷积和渐进Transformer网络的优势

TransBridge:一种轻量级的参数高效混合模型。TransBridge由transformer和基于cnn的编码器-解码器结构组成,用于超声心动图左心室分割

COTR-Net:由卷积层和变压器层组成,用于端到端肾脏、肾囊肿和肾肿瘤的分割。具体来说,COTR-Net的编码器由几个卷积变换块组成,解码器由几个上采样层组成,这些上采样层与编码器有跳过连接。编码器权重使用预训练的ResNet架构进行初始化以加速收敛,并且在解码器层中利用深度监督来提高分割性能。

Cell-DETR:将一个专门的注意力分支集成到DETR框架中,以获得除框预测之外的实例分割掩码

MBT-Net:保留更多的局部细节,并充分利用全局背景,多支路混合Transformer网络

3D

TransBTS:使用3D CNN提取局部3D体积空间特征,并使用transformer编码全局特征

Bi-Transformer U-Net (BiTr-UNet): BiTr-UNet包含一个注意力模块来完善编码器和解码器的特征,并且有两个ViT层(而不是TransBTS中的一个),BiTr-UNet采用后处理策略,如果预测的分割量小于阈值[141],则消除该分割量,然后通过多数投票进行模型集成

VT-UNet:以分层方式分割3D医学图像,引入了两个自注意层来捕获全局和局部上下文,在解码器中引入基于窗口的自注意和交叉注意模块以及傅里叶位置编码,显著提高了VT-UNet的精度和效率,VT-UNet对数据伪像具有鲁棒性,并表现出较强的泛化能力

Swin UNETR:以一种高效的移位窗口划分方案计算自注意力,验证集上表现最好的模型

Spectral Transformer(spectrr):可变形来学习跨光谱维度的上下文特征。为了丢弃不相关的光谱带,他们引入了一种基于稀疏性的方案。此外,他们对每个波段采用单独的组归一化,以消除光谱图像之间分布不匹配造成的干扰。

RAT-Net:区域感知变压器网络:将乳腺肿瘤区域信息融合到多个尺度上,以获得精确分割

6.多器官分割

分割方法分为纯变压器(仅ViT层)和混合架构(包括cnn和ViT层)。

6.1 纯transformer

基于transformer的三维医学图像分割模型,该模型利用三维医学图像patch相邻线性嵌入之间的自注意力

Swin- unet:在局部窗口内计算自注意力,并且相对于输入图像具有线性计算复杂度

混合Transformer

基于混合体系结构的方法结合了transformer和cnn的互补优势,有效地建模全局上下文并捕获局部特征以进行准确分割。我们进一步将这些混合模型分为单尺度和多尺度方法

6.2单规模结构

这些方法仅在一个尺度上处理输入的图像信息,与多尺度体系结构相比,由于计算复杂度低,在医学图像分割中得到了广泛的应用。我们可以根据模型中Transformer层的位置对单尺度体系结构进行分类。这些子类别包括编码器中的变压器,编码器和解码器之间的变压器,编码器和解码器中的变压器以及解码器中的变压器

transformer在编码器中

TransUNet

TransFuse:通过BiFusion模块有效地融合Transformer层和CNN层的特征。BiFusion模块利用自关注和多模态融合机制来选择性地融合特征

门控轴向注意层:在小型医学图像分割数据集上表现良好

Swin UNETR:具有代理任务的新型自监督学习框架,在5,050张CT数据集图像上预训练Transformer编码器

Claw UNet的编码部分集成Transformer层提出了TransClaw UNet,以利用多尺度信息

levi - unet:多阶段架构

Transformer在编码器和解码器之间

Transformer层位于u形架构的编码器和解码器之间

第一项工作是TransAttUNet:注意力和多尺度跳跃连接来增强传统UNet的灵活性,同时利用全局空间注意和变形自注意的表达能力

轴向融合变压器UNet (AFTerUNet):在编码器和解码器之间包含一个计算效率高的轴向融合层,可以有效地融合片间和片内信息,用于3D医学图像分割。

Transformer在编码器和解码器中

UTNet,它有效地将自关注机制的复杂性从二次型降低到线性

nnFormer:基于交错编解码器的架构,其中卷积层编码精确的空间信息,变压器层编码全局上下文

DS-TransUNet:将Swin变压器在u型架构中的优势结合起来用于医学图像分割

Transformer在解码器中

SegTran:用于二维和三维医学图像分割的SE Transformer,还提出了一种可学习的正弦位置编码,帮助模型对空间关系进行编码

6.3多规模结构

2D

PMTrans:利用多分辨率注意力来捕获不同图像尺度上的相关性,使用金字塔结构。PMTrans在不改变自注意计算的总体复杂度的情况下,通过自适应的小块分割方案来访问不同的接受域。

Multi-Compound transformer (MCTrans):不仅学习相同语义类别的特征一致性,还捕获不同语义类别之间的相关性

3D

UNETR由一个纯变压器作为编码器来学习输入量的序列表示。编码器通过跳过连接连接到基于cnn的解码器,以计算最终的分割输出

UNETR的缺点之一是在处理大型3D输入量时计算复杂性大

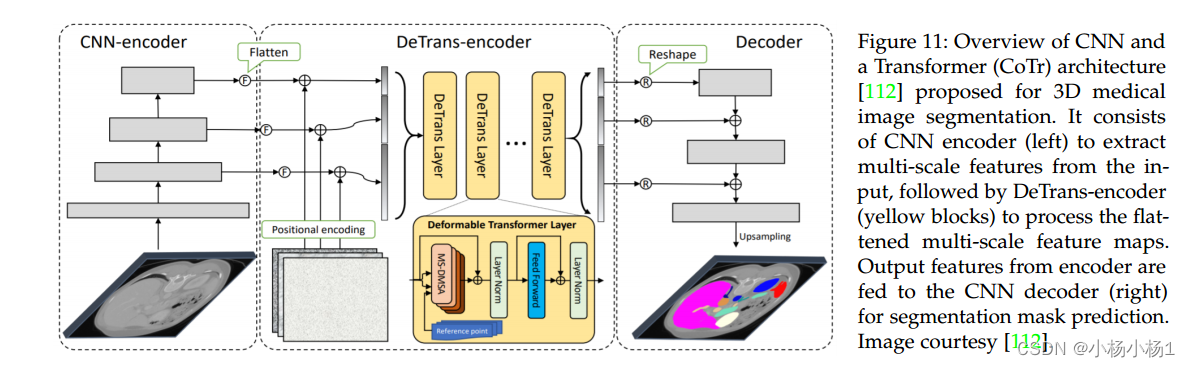

图中关注可变形注意力模块

小结

在多个层次提取特征的高计算成本阻碍了多尺度架构在医学分割任务中的适用性。这些多尺度架构利用了对输入图像信息的多层次处理,并取得了比单尺度架构更好的性能。因此,为多尺度处理设计高效的变压器结构是一个值得关注的问题。

大多数提出的基于vit的模型都是在ImageNet数据集上进行预训练的,用于医学图像的下游任务分割。这种方法是次优的,因为在自然和医学图像模式之间有很大的领域差距。目前,研究医学影像数据集的自监督预训练对ViTs分割性能影响的研究很少。然而,这些工作表明,当直接应用于其他医学成像模式(MRI)时,在一种模式(CT)上预训练的ViT表现不理想,因为大的域间隙使其成为一个令人兴奋的探索途径。

目前基于视觉视觉的方法主要集中在二维医学图像分割上。通过结合时间信息来设计定制的建筑组件以实现高效的高分辨率和高维分割的体图像尚未得到广泛的研究。最近,已经做出了一些努力,例如,UNETR使用基于Swin Transformer的架构来避免二次计算复杂性;然而,这需要社会各界的进一步关注。

除了关注数据集的规模之外,随着vit的出现,我们注意到需要收集更多样化和更具挑战性的医学成像数据集。尽管各种具有挑战性的数据集对于衡量vit在其他医学成像应用中的性能也至关重要,但由于该领域大量涌入了基于vit的模型,因此它们与医学图像分割特别相关。我们相信这些数据集将在探索ViTs在医学图像分割中的局限性方面发挥决定性作用。

————————————————

版权声明:本文为CSDN博主「小杨小杨1」的原创文章,遵循CC 4.0 BY-SA版权协议,转载请附上原文出处链接及本声明。

原文链接:https://blog.csdn.net/qq_45745941/article/details/132392065